对比学习在CV与NLP领域的研究进展及自然科学应用

对比学习(Contrastive Learning)作为自监督学习的重要分支,近年来在计算机视觉(CV)和自然语言处理(NLP)领域取得了显著进展,并在自然科学研究中展现出广阔的应用前景。以下从技术原理、领域进展和自然科学应用三个方面进行阐述。

一、技术原理概述

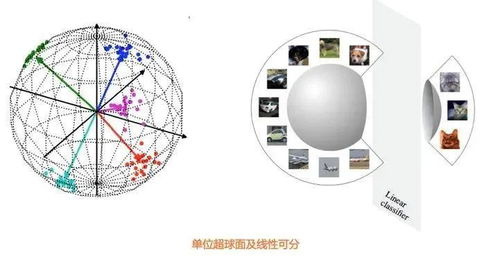

对比学习的核心思想是通过构建正负样本对,让模型学习到数据中的内在表示。其目标函数通常最大化正样本对的相似度,同时最小化负样本对的相似度。在CV领域,常用数据增强技术(如裁剪、旋转)构建正样本;在NLP领域,则通过文本改写、掩码语言模型等方式生成对比样本。

二、CV领域研究进展

- 里程碑模型:MoCo、SimCLR和BYOL等框架通过改进负样本构建、数据增强策略和预测任务,在ImageNet数据集上达到接近有监督学习的性能。

- 应用拓展:从图像分类延伸到目标检测(如DETR)、语义分割和视频理解,显著降低了标注数据依赖。

- 技术融合:与Transformer架构结合(如MoCo v3),在多模态学习中与CLIP模型协同发展。

三、NLP领域研究进展

- 文本表示学习:SimCSE通过Dropout构建正样本,在语义相似度任务上取得突破;对比学习预训练框架(如DeCLUTR)提升了文本嵌入质量。

- 跨模态应用:CLIP和ALIGN模型通过图文对比学习实现了零样本迁移,推动了多模态研究发展。

- 知识增强:在知识图谱表示学习中,通过对比正负三元组优化实体和关系嵌入。

四、在自然科学研究与试验发展中的应用

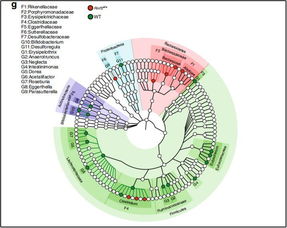

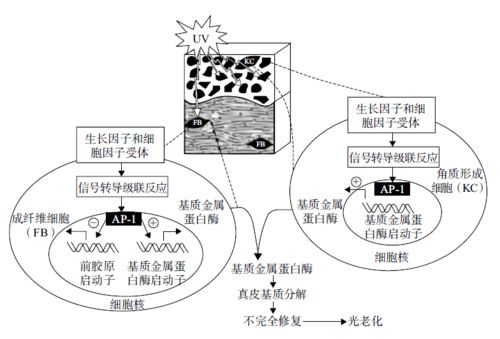

- 生物医学:在蛋白质结构预测(AlphaFold2辅助训练)、药物分子表示学习和医疗影像分析中,对比学习帮助从海量未标注数据中提取有效特征。

- 材料科学:通过对比学习分析材料显微图像,加速新材料的发现和性能预测。

- 地球科学:在遥感图像分类、气候模式识别等任务中,利用对比学习处理缺乏标注的卫星数据。

- 试验优化:在科学实验设计阶段,通过对比学习建模实验参数与结果的关系,减少试验次数。

五、挑战与展望

当前对比学习仍面临负样本偏差、计算复杂度高、领域适应性有限等挑战。未来发展方向包括:

- 开发更高效的正负样本构建策略

- 探索与因果推理、元学习的结合

- 在重大科学问题(如气候变化模拟、疾病机制分析)中深化应用

随着理论不断完善和应用场景拓展,对比学习有望成为推动自然科学研究的通用范式之一,为数据驱动的科学发现提供新动力。

如若转载,请注明出处:http://www.baimeixi.com/product/2.html

更新时间:2026-05-29 12:57:41